par Xukyo | 16 Jan 2025 | Tutoriels

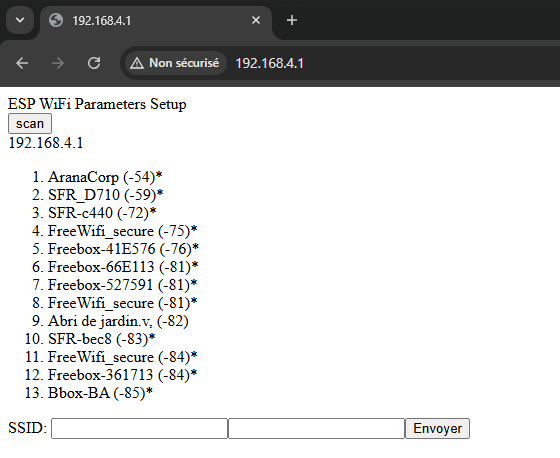

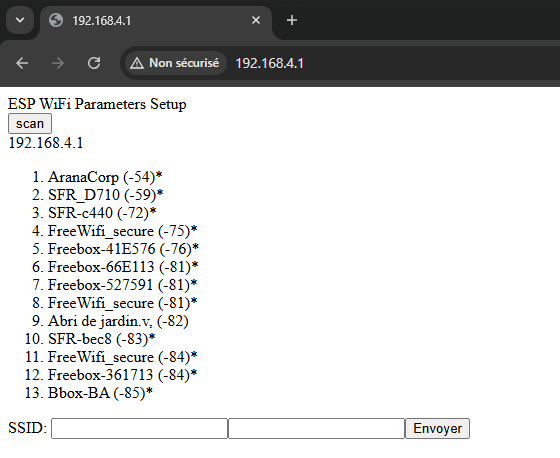

Dans un appareils connectés au WiFi comme un ESP32, les paramètres WiFi sont souvent codés en dur ce qui rend impossible leur modification. Nous allons voir comment modifier les paramètres lorsque le wifi est perdu sans avoir à charger un nouveau code. Principe...

par Xukyo | 16 Jan 2025 | Tutoriels

Dans un appareils connectés au WiFi comme un ESP8266, les paramètres WiFi sont souvent codés en dur ce qui rend impossible leur modification. Nous allons voir comment modifier les paramètres lorsque le wifi est perdu sans avoir à charger un nouveau code. Principe...

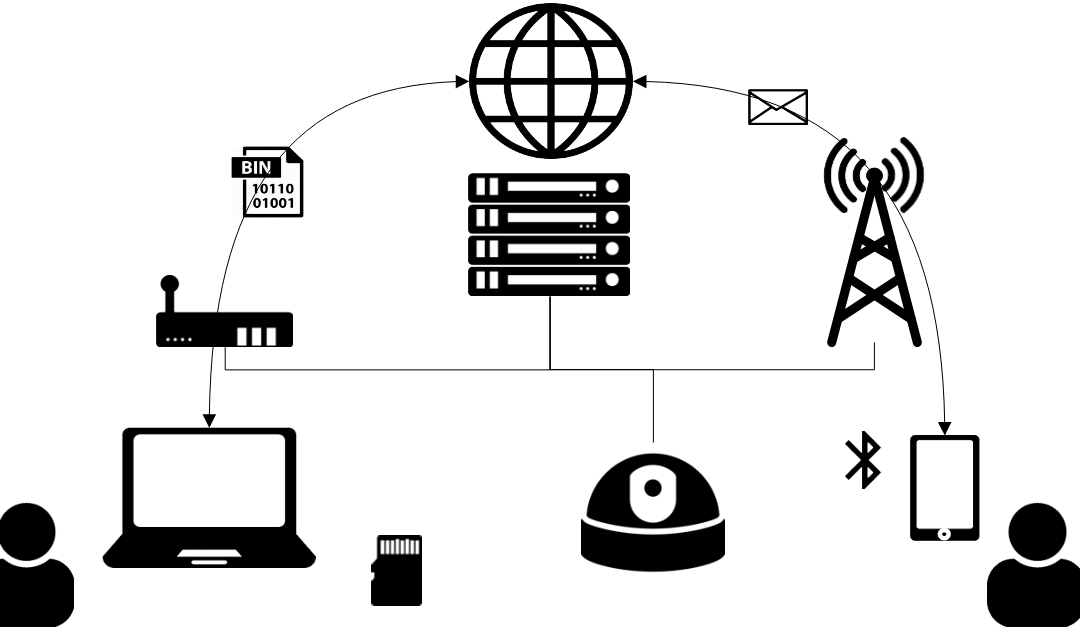

par Xukyo | 16 Déc 2024 | Articles

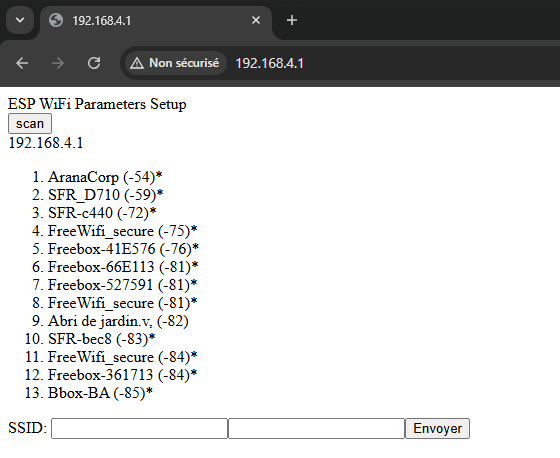

La cybersécurité fait partie des métiers phares de l’informatique. À mesure que la technologie progresse, les risques associés augmentent, exposant les individus, les entreprises et les gouvernements à de multiples menaces. Cet article vise à offrir une vue d’ensemble...

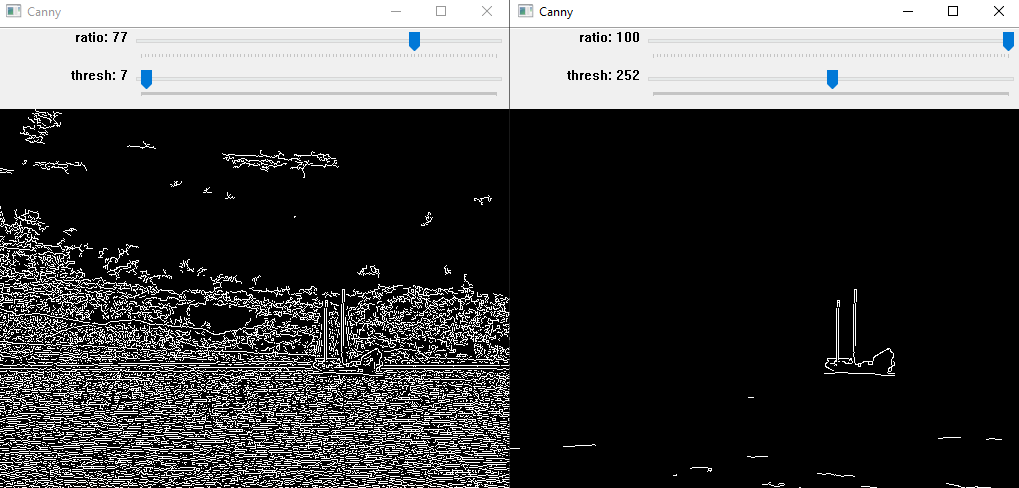

par Xukyo | 26 Nov 2024 | Tutoriels

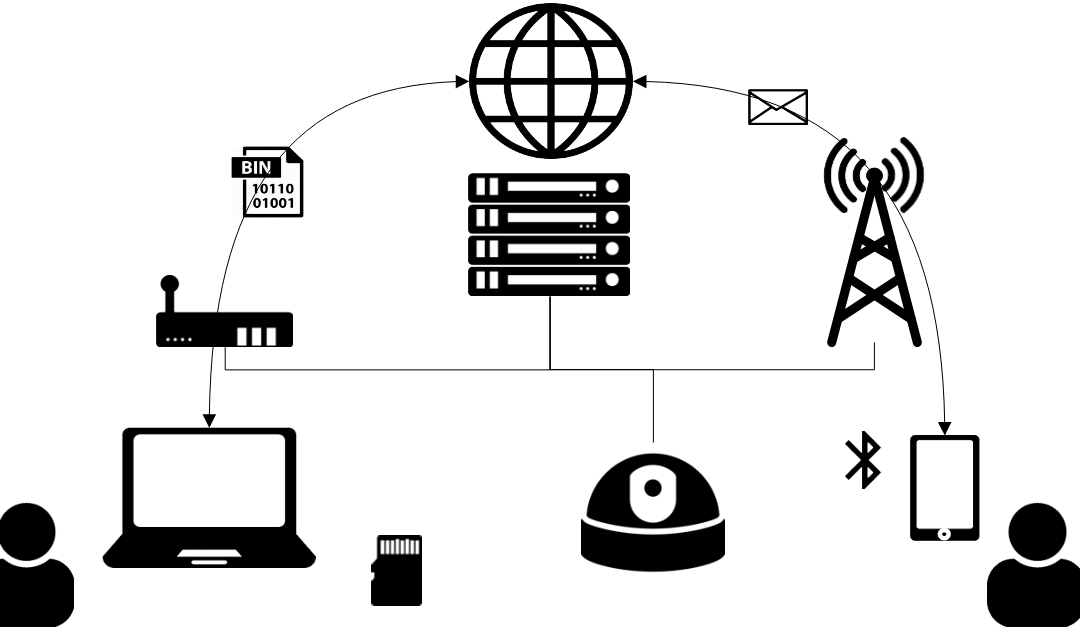

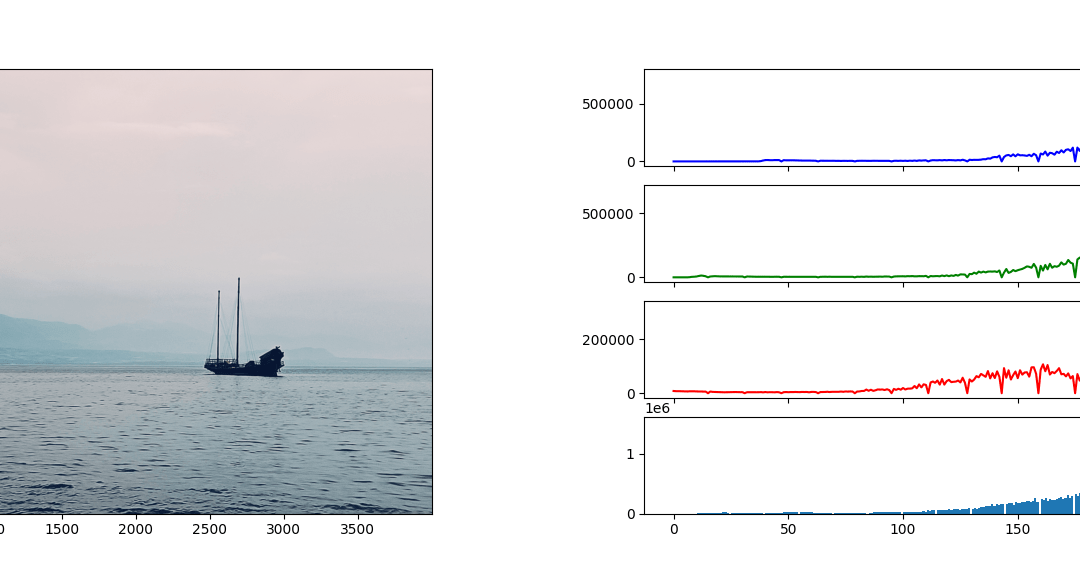

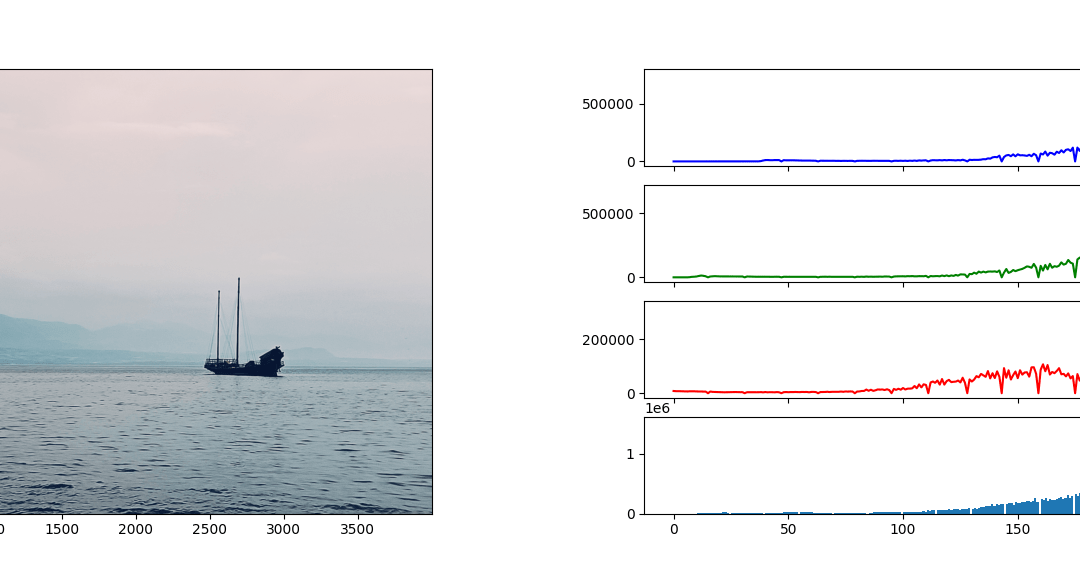

Nous allons voir dans ce tutoriel comment implémenter un algorithme de détection de contour avec Python et OpenCV. La détection de contour est un exercice primordiale pour la vision assistée par ordinateur et la reconnaissance d’objet. Installation et...

par Xukyo | 20 Nov 2024 | Tutoriels

Le module open-source OpenCV est un outil puissant de traitement d’image contenant des algorithmes de vision par ordinateur. Ce module est codé nativement en C++ mais une API est disponible sur Python. On l’utilise pour le traitement d’image, photo...

par Xukyo | 19 Nov 2024 | Tutoriels

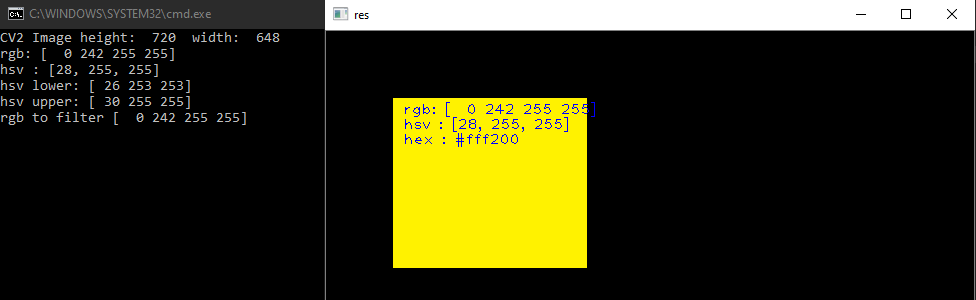

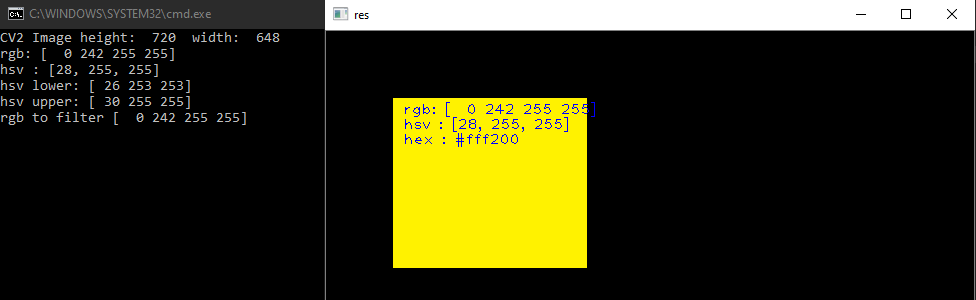

Lors de traitement d’image, il peut être intéressant de filtrer une couleur pour la modifier, la garder ou la supprimer. Nous allons voir dans ce tutoriel comment sélectionner et filtrer une zone de couleur avec OpenCV et Python. Traitement d’image Pour ce...

par Xukyo | 1 Nov 2024 | Tutoriels

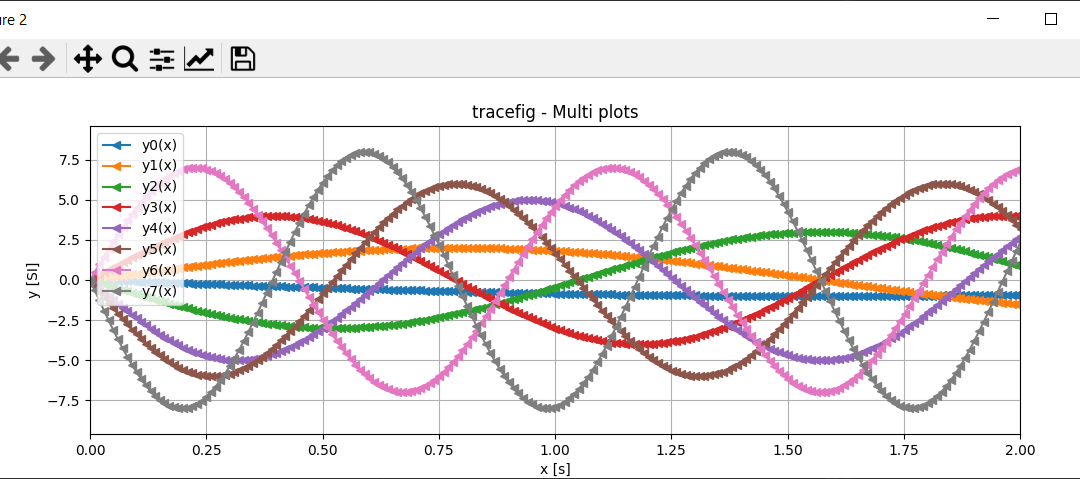

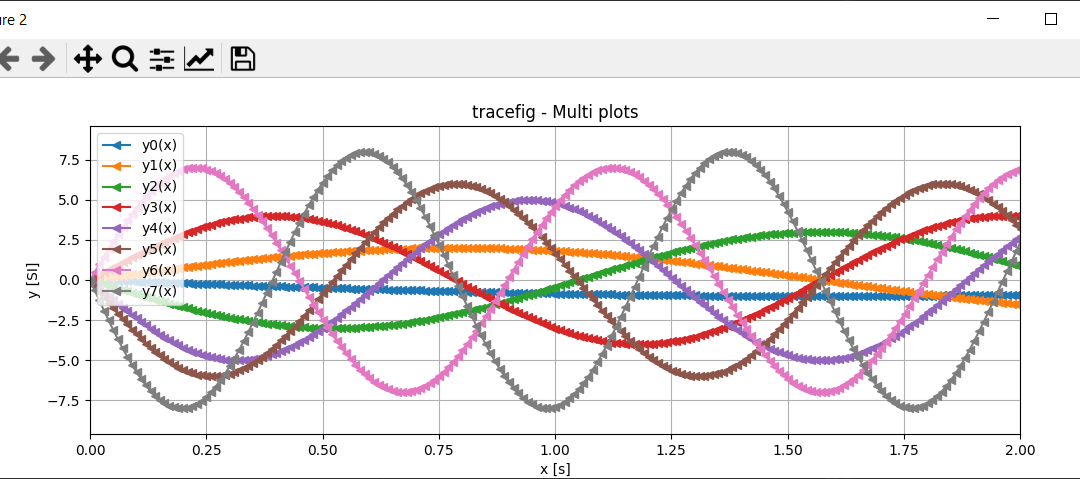

Le paquet Python Matplotlib est un outil puissant pour créer des graphiques et analyser des données sous forme de graphique. Nous allons voir dans ce tutoriel comment utiliser cette librairie et certaines fonctionnalités à connaitre Installation de Matplotlib La...

par Xukyo | 3 Juil 2024 | Tutoriels

Dans le cas de développement de code C/C++ sur systèmes embarqués, notamment, l’optimisation et le test du code sont des points essentiels afin de limiter l’empreinte mémoire et le temps d’exécution. Optimisation du code C pour les systèmes...

par Xukyo | 19 Juin 2024 | Tutoriels

Installation et configuration de VS Code Si ce n’est pas déjà fait, téléchargez et installez Visual Studio Code Installation de l’extension C/C++ dans VS Code Installation de l’extension Code Runner. cette extension est facultative mais vous...

par Xukyo | 23 Mai 2024 | Tutoriels

L’éditeur de code VSCode permet de créer et développer des projets dans différents langages de programmation comme Python ou C++ grâce à de nombreuses extensions. Installation de VSCode Si ce n’est pas déjà fait, téléchargez et installez VSCode...